Bias in KI-Systemen erkennen: Ein praktischer Ansatz für Unternehmen

Stellen Sie sich vor, Ihr Unternehmen setzt ein KI-System im Recruiting ein. Die Software verspricht Objektivität — keine persönlichen Vorurteile, keine Bauchentscheidungen. Doch dann stellt sich heraus: Das System bewertet Bewerberinnen systematisch schlechter als Bewerber. Nicht weil es so programmiert wurde, sondern weil die historischen Daten, mit denen es trainiert wurde, ein Muster enthielten, das niemand hinterfragt hatte.

Kein hypothetisches Szenario. Genau das passierte einem großen Technologiekonzern, der sein KI-gestütztes Bewerbertool nach Jahren interner Nutzung wieder einstellen musste — weil die Trainingsdaten eine überwiegend männliche Bewerberbasis widerspiegelten und das System diese Schieflage als Erfolgsmuster gelernt hatte.

Für Unternehmen, die ihre Werte ernst nehmen, stellt sich eine unbequeme Frage: Spiegeln Ihre KI-Systeme Ihre Unternehmenswerte wider — oder arbeiten sie stillschweigend dagegen?

Was ist Bias in KI-Systemen — und warum ist er so schwer zu erkennen?

Der englische Begriff „Bias“ beschreibt systematische Verzerrungen, die dazu führen, dass ein KI-System bestimmte Gruppen oder Individuen ungerecht bevorzugt oder benachteiligt. Im Unterschied zum bewussten Vorurteil eines Menschen ist KI-Bias oft unsichtbar — eingebettet in Daten, Designentscheidungen und algorithmische Gewichtungen.

Das Bundesamt für Sicherheit in der Informationstechnik (BSI) hat 2025 ein umfassendes Whitepaper zu diesem Thema veröffentlicht. Die zentrale Erkenntnis: Bias kann in jeder Phase des KI-Lebenszyklus entstehen — von der Datenerhebung über die Modellentwicklung bis hin zum laufenden Betrieb. Und er bleibt oft unentdeckt, weil die Komplexität moderner Algorithmen es erschwert, diskriminierende Muster in der Entscheidungsfindung überhaupt nachzuvollziehen.

Dabei geht die Problematik über offensichtliche Fälle hinaus. Auch wenn ein Unternehmen geschützte Merkmale wie Geschlecht oder Herkunft bewusst aus dem Datensatz entfernt, können sogenannte Proxy-Variablen — Stellvertretermerkmale wie Postleitzahl, Schulstandort oder Sprachmuster — indirekt auf genau diese Merkmale schließen lassen. Ein „bereinigter“ Datensatz ist also keineswegs automatisch ein fairer Datensatz.

Warum Bias ein Geschäftsrisiko ist — nicht nur ein Ethikthema

Für werteorientierte Unternehmen ist Fairness in KI-Systemen eine Frage der Glaubwürdigkeit. Aber auch aus rein geschäftlicher Perspektive sind die Risiken erheblich:

Regulatorisches Risiko. Die EU-KI-Verordnung (AI Act) klassifiziert KI-Systeme im Personalwesen als Hochrisiko-Systeme. Artikel 10 fordert explizit Maßnahmen zur Erkennung und Korrektur von Bias in Trainingsdaten. Artikel 13 verlangt Transparenz über die Funktionsweise des Systems. Wer diese Anforderungen nicht nachweisen kann, riskiert Sanktionen nach Artikel 71.

Haftungsrisiko. Das Allgemeine Gleichbehandlungsgesetz (AGG) verbietet Benachteiligungen aufgrund von Geschlecht, Herkunft, Alter, Behinderung und weiteren geschützten Merkmalen. Dass die Diskriminierung von einem Algorithmus statt von einem Menschen ausgeht, schützt den Arbeitgeber nicht vor Schadensersatzansprüchen.

Reputationsrisiko. Wenn öffentlich wird, dass ein KI-System systematisch diskriminiert, ist der Vertrauensschaden kaum reparabel — besonders bei Unternehmen, die sich öffentlich zu Diversität und Nachhaltigkeit bekennen. Die Lücke zwischen dem, was die Karriereseite verspricht, und dem, was der Algorithmus tut, wird dann zum PR-Desaster.

Fehlentscheidungsrisiko. Verzerrte Systeme liefern verzerrte Ergebnisse. Im Recruiting bedeutet das: Die besten Kandidatinnen und Kandidaten werden übersehen. In der Kreditvergabe werden tragfähige Geschäftsmodelle abgelehnt. Bias ist nicht nur ungerecht — er schadet auch Unternehmen.

Fünf Schritte zur Bias-Erkennung: Ein praktischer Rahmen

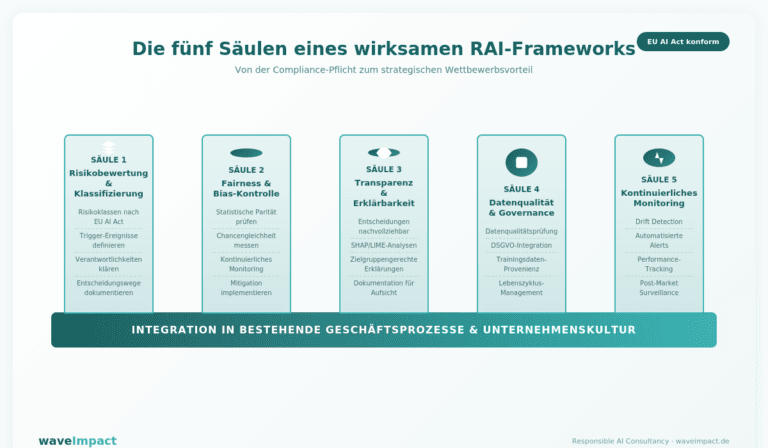

Die gute Nachricht: Bias ist kein unvermeidbares Schicksal. Mit einem systematischen Ansatz lässt sich das Risiko erheblich reduzieren. Die folgenden fünf Schritte bilden einen praxistauglichen Rahmen, der auch ohne Data-Science-Abteilung umsetzbar ist.

1. Inventar erstellen: Welche KI-Systeme laufen — und wo?

Bevor Sie Bias testen können, müssen Sie wissen, wo KI in Ihrem Unternehmen überhaupt Entscheidungen beeinflusst. Viele Organisationen nutzen mehr KI-gestützte Systeme als ihnen bewusst ist: Recruiting-Tools, Chatbots, Scoring-Modelle, Empfehlungssysteme, automatisierte Rechnungsprüfung. Ein KI-Inventar schafft die nötige Übersicht und ist zugleich eine Anforderung des EU AI Act.

2. Risikoklassifizierung: Welche Systeme treffen Entscheidungen über Menschen?

Nicht jedes KI-System birgt das gleiche Bias-Risiko. Ein System, das Lagerbestände prognostiziert, hat ein anderes Risikoprofil als eines, das Bewerbungen vorsortiert. Priorisieren Sie Systeme, die Entscheidungen über Menschen beeinflussen — im Personalwesen, in der Kreditvergabe, im Kundenservice, in der Sozialleistungsverwaltung. Der EU AI Act gibt hier mit seinen Risikokategorien eine hilfreiche Orientierung.

3. Datenqualität prüfen: Repräsentativität, Aktualität, Vollständigkeit

Die häufigste Ursache für Bias liegt in den Trainingsdaten. Prüfen Sie: Sind alle relevanten Gruppen angemessen repräsentiert? Bilden die Daten die aktuelle Realität ab — oder historische Ungleichheiten? Gibt es systematische Lücken oder Verzerrungen? Datenqualität ist nicht glamourös, aber sie ist das Fundament jeder fairen KI.

4. Fairness messen: Quantitative Tests durchführen

Fairness in KI-Systemen lässt sich messen — mit etablierten Metriken wie Statistical Parity, Equalized Odds oder Counterfactual Fairness. Bei Letzterer wird getestet, ob sich das Ergebnis eines Modells ändert, wenn ein einzelnes Attribut hypothetisch verändert wird: Bleibt das Bewerbungsprofil identisch und nur der Vorname wechselt — ändert sich dann die Bewertung? Wenn ja, liegt ein Bias nahe.

Spezialisierte Open-Source-Werkzeuge wie AI Fairness 360 oder Fairlearn ermöglichen solche Tests auch ohne eigenes Forschungslabor. Entscheidend ist, dass die Ergebnisse dokumentiert und nachvollziehbar aufbereitet werden.

5. Governance-Struktur aufsetzen: Verantwortlichkeiten benennen, Monitoring etablieren

Einmaliges Testen reicht nicht. KI-Systeme verändern sich im Betrieb — durch neue Daten, veränderte Nutzerinteraktionen oder Modell-Updates. Ein nachhaltiger Ansatz erfordert klare Verantwortlichkeiten (wer ist für Fairness zuständig?), definierte Prüfintervalle und ein Monitoring, das Abweichungen frühzeitig erkennt. Das BSI empfiehlt ausdrücklich eine Überwachung über den gesamten Lebenszyklus.

Fairness ist kein Zustand, sondern ein Prozess

Ein verbreiteter Irrtum: Man könne ein KI-System einmal auf Fairness prüfen und das Thema dann abhaken. In der Praxis ist Fairness ein kontinuierlicher Prozess. Daten verändern sich, gesellschaftliche Normen entwickeln sich weiter, und was heute als fair gilt, kann morgen anders bewertet werden.

Genau deshalb ist Bias-Erkennung keine rein technische Aufgabe. Sie erfordert eine Verbindung von technischer Kompetenz, regulatorischem Verständnis und — das wird oft unterschätzt — einer klaren Auseinandersetzung mit den eigenen Unternehmenswerten. Was bedeutet Fairness für *Ihr* Unternehmen? Welche Ergebnisse wären inakzeptabel? Ohne diese Klärung bleiben auch die besten Metriken beliebig.

Was am Ende steht: Prüfbare Ergebnisse statt abstrakter Absichten

Unternehmen, die Bias-Erkennung ernst nehmen, haben am Ende mehr als nur ein gutes Gewissen. Sie haben ein dokumentiertes Fairness-Assessment: eine belastbare Analyse, die zeigt, ob Ihre KI-Systeme tun, was Ihre Werte versprechen. Sie haben ein KI-Inventar mit klarer Risikoklassifizierung. Sie haben benannte Verantwortlichkeiten und einen Monitoring-Plan, der Bias nicht nur einmalig prüft, sondern dauerhaft im Blick behält.

Das ist die Art von Dokumentation, die gegenüber Prüfern, Investoren oder dem eigenen Aufsichtsrat Bestand hat — und die den Unterschied macht zwischen einem Unternehmen, das Fairness behauptet, und einem, das sie nachweisen kann.

Setzt Ihr Unternehmen KI ein — und wollen Sie sicherstellen, dass Ihre Systeme zu Ihren Werten passen? waveImpact unterstützt werteorientierte Unternehmen mit strukturierten Fairness-Assessments: von der Bestandsaufnahme über quantitative Bias-Tests bis zur prüfbaren Governance-Dokumentation. [Sprechen Sie uns an](/kontakt) — das Erstgespräch ist unverbindlich.

Weiterführende Quellen: