Und warum es mehr mit Ihren Werten zu tun hat als mit Regulierung

Veröffentlicht am 28. Februar 2026 | Lesezeit: ca. 9 Minuten

Viele Unternehmen begegnen dem Thema „verantwortungsvolle KI“ zum ersten Mal über den EU AI Act. Das ist verständlich — aber es ist der falsche Einstieg. Responsible AI beginnt nicht bei Paragrafen. Es beginnt bei der Frage, welche Art von Unternehmen Sie sein wollen.

KI ist längst da — die Frage ist, ob sie zu Ihnen passt

Wer heute ein Unternehmen führt, nutzt künstliche Intelligenz. Oft ohne es so zu nennen: im Bewerbungsscreening, in der Kundenanalyse, bei der Kreditwürdigkeitsprüfung, in der Produktionssteuerung, im Kundenservice. Die Tools sind verfügbar, die Versprechen groß, der Wettbewerbsdruck real.

Gleichzeitig wächst bei vielen Unternehmern ein Unbehagen. Nicht gegenüber der Technologie selbst, sondern gegenüber der Art, wie sie eingesetzt wird. Wer sich öffentlich zu Nachhaltigkeit, Fairness oder gesellschaftlicher Verantwortung bekennt — in ESG-Berichten, in der Unternehmenskommunikation, im täglichen Handeln — der spürt: KI passt nicht automatisch zu diesen Werten. Sie kann sie stärken oder untergraben.

Responsible AI ist der Versuch, diese Lücke zu schließen.

Was Responsible AI tatsächlich bedeutet

Der Begriff klingt nach einer weiteren Compliance-Anforderung. Tatsächlich beschreibt er etwas Grundlegenderes: einen Rahmen dafür, wie Organisationen KI-Systeme so entwickeln und einsetzen, dass sie Fairness, Transparenz, Sicherheit und menschliche Kontrolle gewährleisten.

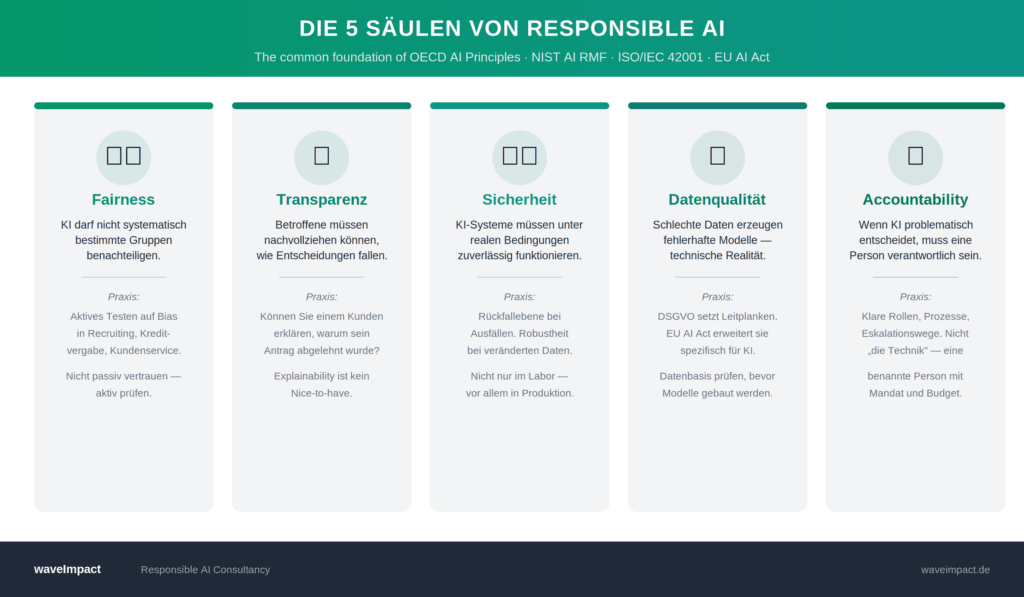

Die gängigen Frameworks — von der OECD über das NIST AI Risk Management Framework bis hin zur ISO/IEC 42001 — stimmen in fünf zentralen Prinzipien überein:

Fairness bedeutet, dass ein KI-System nicht systematisch bestimmte Gruppen benachteiligt. Das klingt selbstverständlich, ist es aber nicht. Ein Recruiting-Tool, das auf historischen Bewerbungsdaten trainiert wurde, reproduziert die Verzerrungen der Vergangenheit — nicht aus Bosheit, sondern aus Mathematik. Fairness in KI erfordert aktives Prüfen, nicht passives Vertrauen.

Transparenz bedeutet nicht, dass jeder den Quellcode lesen muss. Aber wer von einer KI-Entscheidung betroffen ist — sei es als Bewerber, Kunde oder Mitarbeiter — sollte nachvollziehen können, auf welcher Grundlage diese gefallen ist. Die EU spricht hier von „Erklärbarkeit“ (Explainability). In der Praxis heißt das: Kann ich einem Kunden erklären, warum sein Antrag abgelehnt wurde? Kann ich dem Betriebsrat gegenüber begründen, wie das Schichtplanungstool Prioritäten festlegt?

Sicherheit und Robustheit stellen sicher, dass KI-Systeme unter realen Bedingungen zuverlässig funktionieren — nicht nur im Labor. Ein System, das bei leicht veränderten Eingabedaten völlig andere Ergebnisse liefert, ist nicht robust. Ein System, das bei Ausfällen keine Rückfallebene hat, ist nicht sicher.

Datenschutz und Datenqualität bilden die Grundlage jeder verantwortungsvollen KI. Schlechte Daten erzeugen fehlerhafte Modelle — das ist keine philosophische Frage, sondern eine technische Realität. Die DSGVO setzt hier bereits Leitplanken, die durch den EU AI Act nun spezifisch für KI-Systeme erweitert werden.

Verantwortlichkeit (Accountability) beantwortet die einfachste und wichtigste Frage: Wer ist zuständig? Wenn ein KI-System eine problematische Entscheidung trifft, muss es eine Person geben, die dafür geradestehen kann — nicht „die Technik“ oder „der Algorithmus“. Das erfordert klare Governance-Strukturen: Rollen, Prozesse, Eskalationswege.

Warum Compliance allein nicht reicht

Der EU AI Act tritt in seinen zentralen Bestimmungen am 2. August 2026 in Kraft. Er klassifiziert KI-Systeme nach Risiko und verpflichtet Anbieter und Betreiber zu Dokumentation, Risikomanagement, menschlicher Aufsicht und Transparenz. Das ist wichtig und überfällig.

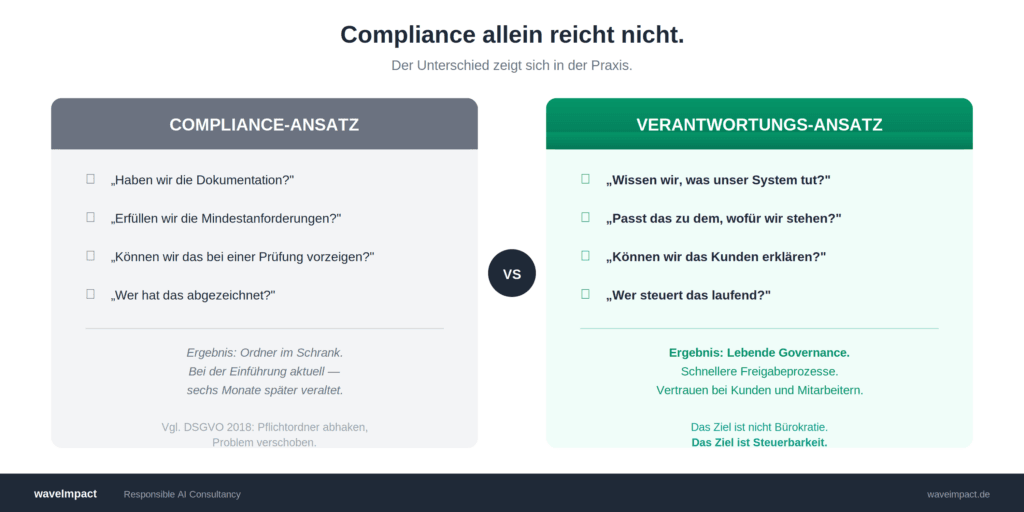

Aber wer Responsible AI nur als Compliance-Projekt begreift, macht denselben Fehler wie viele Unternehmen bei der DSGVO: den Pflichtordner abhaken und anschließend weitermachen wie bisher. Die Erfahrung aus 2018 zeigt, was passiert. Unternehmen, die Datenschutz als Dokumentationsübung behandelt haben, stehen heute vor denselben Problemen wie damals — nur mit mehr Ordnern im Schrank.

Der Unterschied zwischen Compliance und Verantwortung zeigt sich erst in der Praxis. Compliance fragt: „Haben wir die Dokumentation?“ Verantwortung fragt: „Wissen wir, was unser System tut — und passt das zu dem, wofür wir stehen?“

Das ist kein moralischer Appell. Es ist ein wirtschaftlicher. Unternehmen, die KI-Governance ernst nehmen, berichten von konkreten Vorteilen: schnellere Freigabeprozesse für neue KI-Projekte, weil klare Bewertungskriterien existieren. Weniger Reibungsverluste zwischen IT und Geschäftsleitung, weil die Rollen definiert sind. Und vor allem: mehr Vertrauen — bei Kunden, Mitarbeitern und Geschäftspartnern.

Was das mit ESG und Unternehmenswerten zu tun hat

Hier wird es für werteorientierte Unternehmen besonders relevant. Wer heute einen Nachhaltigkeitsbericht erstellt, muss zunehmend auch den Einsatz digitaler Technologien berücksichtigen. Die CSRD verlangt Transparenz über wesentliche Risiken — und KI-Systeme, die Entscheidungen über Menschen treffen, sind ein wesentliches Risiko.

Gleichzeitig steigt der Druck von außen. Kunden fragen nach: Wie stellt ihr sicher, dass eure KI fair arbeitet? Bewerber erwarten: Ein Unternehmen, das sich „verantwortungsvoll“ nennt, sollte das auch beim Einsatz von Technologie zeigen. Investoren prüfen: Gibt es eine dokumentierte KI-Governance — oder nur Absichtserklärungen?

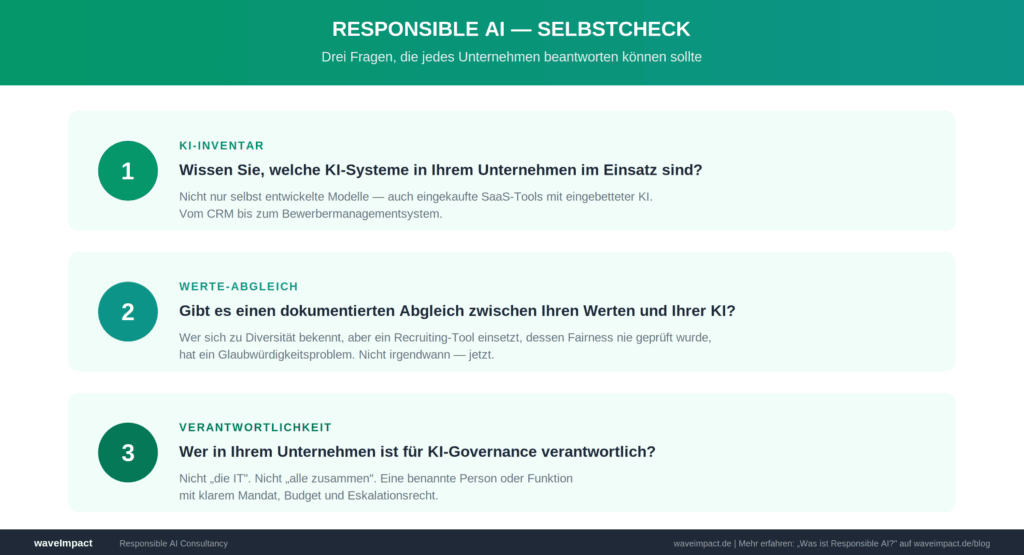

Responsible AI schließt die Lücke zwischen dem, was ein Unternehmen über sich selbst sagt, und dem, was seine Technologie tatsächlich tut. Das ist keine abstrakte Übung. Es lässt sich auf drei konkrete Fragen herunterbrechen:

Erstens: Wissen Sie, welche KI-Systeme in Ihrem Unternehmen im Einsatz sind? Ein vollständiges Inventar klingt zwar trivial, ist aber in den wenigsten Organisationen vorhanden. Dazu gehören nicht nur selbst entwickelte Modelle, sondern auch eingekaufte SaaS-Tools mit eingebetteter KI — vom CRM bis zum Bewerbermanagementsystem — und nicht zu vergessen die Schatten-KI, die am Arbeitsplatz mit privaten Accounts genutzt wird.

Zweitens: Gibt es einen dokumentierten Abgleich zwischen Ihren Unternehmenswerten und dem tatsächlichen Verhalten Ihrer KI-Systeme? Ein Unternehmen, das sich für Diversität einsetzt, aber ein Recruiting-Tool einsetzt, dessen Fairness nie geprüft wurde, hat ein Glaubwürdigkeitsproblem. Nicht irgendwann. Jetzt.

Drittens: Wer in Ihrem Unternehmen ist für KI-Governance verantwortlich? Nicht „die IT“. Nicht „alle zusammen“ oder „jeder für sich selbst“. Eine benannte Person oder Funktion mit klarem Mandat, Budget und Eskalationsrecht.

Was Responsible AI konkret erfordert — in der Praxis

Die gute Nachricht: Responsible AI ist kein Mammutprojekt, das Jahre verschlingt. Für die meisten Unternehmen besteht ein solider Einstieg aus vier Bausteinen:

Ein KI-Inventar, das alle Systeme erfasst, die KI-Komponenten enthalten — inklusive Zweck, Datenquellen, betroffene Personengruppen und Verantwortlichkeiten. Das muss kein IT-Audit sein. Es beginnt mit der simplen Frage an jede Abteilung: „Nutzt ihr Tools, die Entscheidungen automatisieren oder vorbereiten?“

Eine Risikobewertung, die jedes System nach seiner Wirkung auf Menschen einordnet. Der EU AI Act gibt hier eine Struktur vor: vier Risikostufen von minimal bis unakzeptabel. Die ISO/IEC 42001 ergänzt das um einen systematischen Rahmen für das gesamte KI-Managementsystem. Entscheidend ist nicht die Detailtiefe beim ersten Durchgang, sondern dass überhaupt eine strukturierte Bewertung stattfindet.

Dokumentierte Governance, die regelt, wer neue KI-Projekte freigibt, nach welchen Kriterien Risiken bewertet werden und wie Monitoring im laufenden Betrieb funktioniert. Das muss keine eigene Abteilung sein. In vielen Unternehmen lässt sich das in bestehende Compliance- oder Risikomanagement-Strukturen integrieren — wenn die Verantwortlichkeiten klar benannt sind.

Regelmäßiges Monitoring, das prüft, ob KI-Systeme sich im laufenden Betrieb wie erwartet verhalten. Modelle verändern sich über Zeit — durch neue Daten, veränderte Nutzung oder technische Updates. Ein System, das bei der Einführung fair war, kann sechs Monate später systematische Verzerrungen aufweisen. Monitoring ist keine Option, sondern Pflicht — moralisch wie regulatorisch.

Der richtige Zeitpunkt ist jetzt — aber nicht aus Panik

Wer diesen Artikel liest, gehört vermutlich nicht zu denen, die erst handeln, wenn die Behörde klopft. Werteorientierte Unternehmer handeln aus Überzeugung — und die Überzeugung, dass Technologie den eigenen Werten dienen sollte, ist kein Nischenthema mehr.

Die OECD hat erst im Februar 2026 einen neuen Leitfaden für verantwortungsvolle KI-Sorgfaltspflicht veröffentlicht. Die EU arbeitet an harmonisierten Standards, die die technischen Anforderungen des AI Acts konkretisieren. Die ISO/IEC 42001 hat sich als internationaler Referenzrahmen für KI-Managementsysteme etabliert. Die Rahmenbedingungen verdichten sich — und sie belohnen diejenigen, die früh beginnen.

Das Ziel ist nicht Bürokratie. Das Ziel ist Steuerbarkeit. Wer heute die Grundlagen legt — Inventar, Risikobewertung, Governance-Struktur — hat am 2. August 2026 nicht nur eine Compliance-Checkliste abgehakt, sondern auch eine Organisation, die KI bewusst einsetzt. Und das macht einen Unterschied, den Kunden, Mitarbeiter und Geschäftspartner wahrnehmen.

Verantwortungsvolle KI ist kein Projekt mit einem Enddatum. Es ist eine Haltung, die sich in Strukturen ausdrückt. Wenn Sie wissen möchten, wo Ihr Unternehmen steht — schreiben Sie mir. Ein erstes Gespräch ist unverbindlich und dauert ca. 20 Minuten.

Newsletter: Für regelmäßige Einordnungen zu KI-Strategie, KI-Governance, EU AI Act und Responsible AI können Sie sich hier anmelden: